存儲架構升級背景下的多源數據智能入湖 構建高效數據處理與存儲支持服務

在數字化轉型浪潮中,企業數據量激增,來源日益復雜,傳統存儲架構已難以滿足高效、低成本的數據管理與分析需求。存儲架構升級成為必然選擇,而數據湖作為集中式存儲庫,因其能容納結構化、半結構化和非結構化數據,正成為現代數據架構的核心。如何將分散在多源異構系統中的數據快速、準確地“匯入”數據湖,是許多企業面臨的關鍵挑戰。此時,一個集成的智能入湖通道及配套的數據處理和存儲支持服務,便成為破局的關鍵。

一、多源數據入湖的挑戰與智能通道的誕生

多源數據入湖的復雜性主要體現在幾個方面:

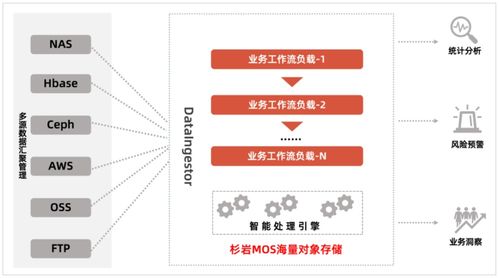

- 來源多樣:數據可能來自業務數據庫(如Oracle、MySQL)、日志文件、物聯網設備、第三方API、SaaS應用等,格式和協議各異。

- 數據質量參差:數據可能存在不一致、重復、缺失或格式錯誤等問題。

- 時效性要求高:業務決策往往需要近實時或實時的數據支持,對數據同步速度要求苛刻。

- 運維管理復雜:手動編寫和維護大量數據同步腳本,工作繁重且易出錯。

“智能入湖通道”正是針對這些痛點而設計的解決方案。它并非單一工具,而是一個集成了數據采集、傳輸、處理、監控等能力的自動化平臺或服務框架。其核心目標是實現數據的 “快速、穩定、智能、可管理” 入湖。

二、智能入湖通道的核心能力

一個高效的智能入湖通道通常具備以下關鍵特性:

- 全連接器支持:提供豐富的預置連接器,能夠無縫對接主流數據庫、消息隊列(如Kafka)、文件存儲、云服務及API等數據源,實現“開箱即用”的數據抽取。

- 實時與批量一體化:支持變化數據捕獲(CDC)實現實時數據同步,同時也支持定時批量導入,滿足不同場景的時效性需求。

- 自動化數據預處理:在數據入湖過程中,內置數據清洗、格式轉換、輕量級ETL、去重、標準化等處理能力,確保入湖數據質量。

- 元數據自動感知與管理:自動捕獲源數據的元數據(Schema),并在入湖時進行注冊和管理,為后續的數據發現、血緣分析和治理奠定基礎。

- 彈性可擴展與高可靠:采用分布式架構,能夠根據數據吞吐量動態伸縮。具備完善的故障恢復和斷點續傳機制,保障數據傳輸的穩定性和一致性。

- 可視化配置與監控:提供低代碼或無代碼的圖形化配置界面,簡化任務編排。同時提供全鏈路監控看板,實時展示數據流入狀態、速度、延遲及異常告警。

三、數據處理與存儲支持服務:賦能數據價值釋放

數據成功入湖只是第一步,要讓數據產生價值,離不開強大的數據處理和存儲支持服務。這些服務與智能入湖通道緊密協同,構成完整的數據流水線。

- 分層存儲服務:數據湖存儲支持服務會根據數據的訪問頻率和成本要求,自動實施分層存儲策略。例如,將熱數據放在高性能存儲(如SSD),溫數據放在標準對象存儲,冷數據歸檔至低成本存儲,從而實現成本與性能的最優平衡。

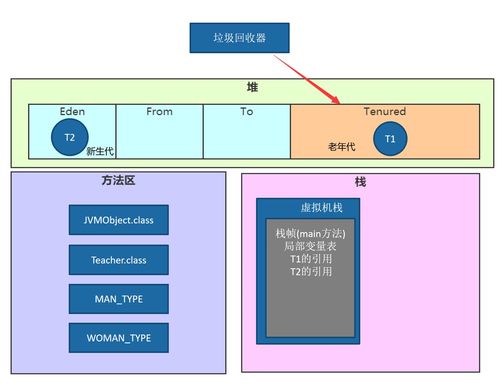

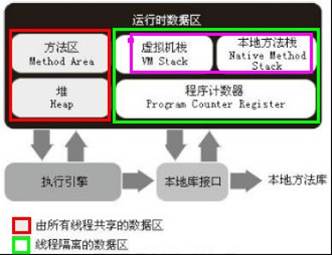

- 統一計算引擎支持:提供對Spark、Flink、Presto等主流大數據計算引擎的深度集成與優化支持,用戶可以直接對湖中數據進行交互式查詢、批量分析和流處理,無需二次搬遷數據。

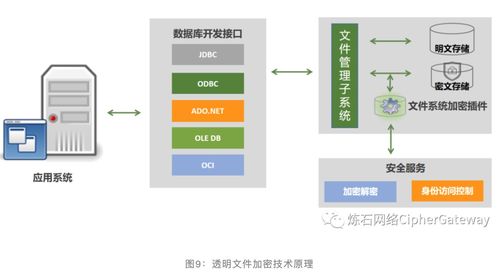

- 數據治理與安全服務:提供統一的數據目錄、數據血緣、數據質量監控和數據分級分類能力。集成細粒度的權限控制、數據加密和審計日志,確保數據在存儲和處理過程中的安全與合規。

- Serverless數據處理服務:提供按需使用的無服務器數據處理能力,用戶只需提交處理邏輯,平臺自動分配和調度計算資源,完成后自動釋放,極大簡化運維并提升資源利用率。

- AI增強的數據管理:利用機器學習技術,智能預測數據熱度、優化存儲布局、自動識別數據異常模式、推薦數據關聯關系等,使整個數據處理和存儲過程更加智能化。

四、實施路徑與展望

構建這樣一套體系,建議采用分步實施的策略:

- 評估與規劃:梳理現有數據源、分析業務場景需求,設計目標數據湖架構和入湖規范。

- 通道建設與試點:優先部署智能入湖通道,選擇關鍵數據源進行入湖試點,驗證通道的穩定性與數據質量。

- 服務集成與擴展:逐步引入和集成計算引擎、治理工具、安全服務等,擴展數據處理能力。

- 運營與優化:建立持續的數據運營體系,基于監控反饋和使用情況,不斷優化入湖策略、存儲方案和計算任務。

隨著云原生、存算分離、DataOps等理念的深入,智能入湖通道將與數據處理、存儲服務更深度地融合,向一體化、自動化、智能化的“數據流水線工廠”演進。企業通過擁抱這一套完整的解決方案,不僅能解決多源數據快速入湖的燃眉之急,更能夯實數據基礎,敏捷響應業務變化,真正釋放數據作為核心生產要素的無限潛能。

如若轉載,請注明出處:http://www.0572hr.cn/product/73.html

更新時間:2026-04-10 14:42:17